6 دقیقه

اگر از یک چتبات هوش مصنوعی درباره قیمت یک سهام، تاریخ یک جلسه دادگاهی یا نام یک مدیر شرکت سؤال کنید، پاسخ ممکن است با تمام اطمینان ارائه شود. این همان بخش نگرانکننده است. جمله ممکن است روان و لحنی مطمئن داشته باشد، اما واقعیتها میتوانند نادرست باشند.

یک تحلیل جدید از قابلیت اطمینان شرکت Legal Guardian Digital، یک شرکت سئو که روی دفاتر حقوقی تمرکز دارد، اعداد را پشت مشکلی که بسیاری از کاربران قبلاً آن را میشناسند قرار میدهد: برخی از چتباتهای محبوب هوش مصنوعی بسیار بیشتر از دیگران هالوسینه میکنند. با توجه به اینکه حدود یکچهارم کارکنان آمریکایی اکنون بهطور منظم از ابزارهای هوش مصنوعی استفاده میکنند، تفاوت بین یک دستیار مفید و منبعی قانعکننده از اطلاعات غلط جزئیات کوچکی نیست.

بخش ناراحتکننده: اطمینان برابر با دقت نیست

مدلهای بزرگ زبانی مثل انسانها فکر نمیکنند. آنها آموزش دیدهاند تا بر اساس الگوها در حجم بسیار زیادی از متن، کلمات و عبارات محتمل را پیشبینی کنند. وقتی سیستم زمینه کافی دارد، این میتواند پاسخهای سریع و مفیدی تولید کند. وقتی زمینه کافی نیست، مدل ممکن است همچنان پاسخی تولید کند که منطقی بهنظر میرسد چون از نظر آماری کلمات با هم جور در میآیند.

این چیزی است که مردم معمولاً وقتی میگویند یک چتبات هوش مصنوعی هالوسینه میکند، منظورشان است. این خوابدیدن نیست. این دروغگویی به معنای انسانی نیست. این تولید پاسخ بدون پایهای قابل اعتماد از واقعیت است، به همین دلیل نامها، تاریخها، منابع قانونی، جزئیات پزشکی، ارقام مالی و اخبار فوری هنوز نیاز به تأیید انسانی دارند.

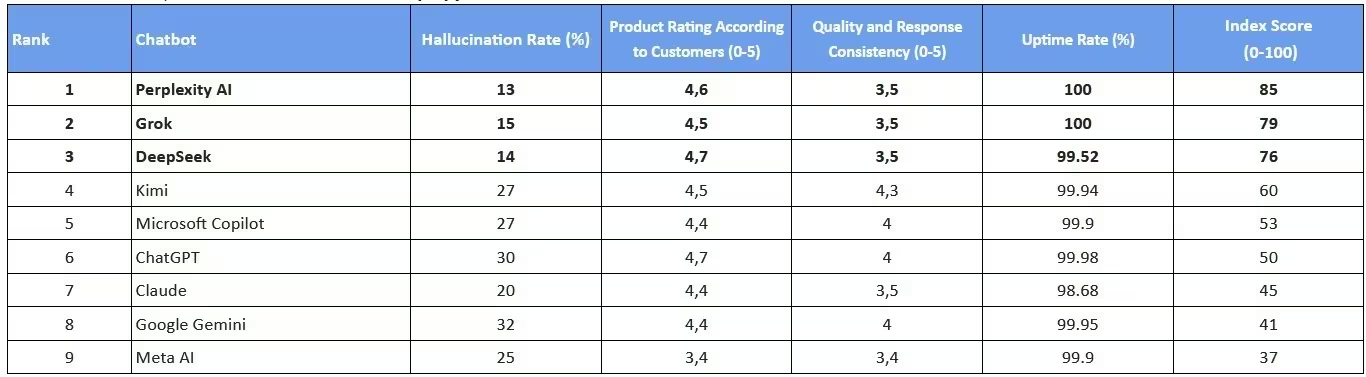

این مطالعه چند مدل شناختهشده را با نگاه به نرخ هالوسینه شدن، رضایت مشتری، کیفیت پاسخها و زمان در دسترس بودن مقایسه کرد. این عوامل در یک امتیاز شاخص از 0 تا 100 ترکیب شدند تا دید گستردهتری از کدام چتباتها در استفاده روزمره قابلاعتمادتر هستند ارائه شود.

گوگل جمینی با بیشترین نرخ هالوسینه در این گروه ظاهر شد و گفته میشود در 32٪ از پاسخها اطلاعات نادرست تولید کرده است. این عدد بهویژه جالب است با توجه به گزارشهایی که میگویند اپل سالانه حداقل یک میلیارد دلار به گوگل پرداخت میکند تا از یک مدل سفارشی جمینی با 1.2 تریلیون پارامتر برای ارتقای آتی سیری استفاده کند که انتظار میرود با آیاواس 27 عرضه شود.

چتجیپیتی با فاصله نزدیک دنبال شد، بهطوریکه هالوسینهها در حدود سه پاسخ از هر ده پاسخ مشاهده شد. ساده بگوییم، اگر این ارقام برقرار باشند، چتجیپیتی تقریباً دو برابر احتمال دارد در این آزمایش پاسخ غلط بدهد نسبت به دیپسیک. این مقایسه احتمالاً توجه زیادی جلب خواهد کرد، نه کمتر از اینکه دیپسیک با کسری از هزینههای آموزش مرتبط با مدلهای پیشرو آمریکا توسعه یافته است.

پرپلکسیتی اِیآی در نرخ هالوسینه بهترین عملکرد را داشت و پاسخهای نادرست در 13٪ موارد به کاربران رسیدند. دیپسیک با 14٪ نزدیک پشت سر آن بود، در حالی که گروک متعلق به ایلان ماسک در 15٪ قرار گرفت. برای کاربرانی که برای تحقیق، خلاصهسازی یا بررسیهای سریع از هوش مصنوعی استفاده میکنند، این اختلافها اهمیت دارد.

آنلاین بودن هنوز مهم است

دقت تنها بخشی از داستان است. یک چتبات ممکن است روی کاغذ درخشان باشد اما اگر زمانی که کسی به آن نیاز دارد در دسترس نباشد، بیفایده است. از نظر زمان در دسترس بودن، پرپلکسیتی اِیآی و گروک تنها دو سرویسی بودند که در طول دوره آزمایش همیشه در دسترس باقی ماندند.

چتجیپیتی و جمینی فاصله زیادی نداشتند و نرخهای آپتایم آنها بهترتیب 99.98٪ و 99.95٪ بود. حتی کلود که پایینترین آپتایم را در مطالعه داشت نیز با 99.68٪ بسیار قابلاعتماد باقی ماند. از نظر عملی، بیشتر این ابزارها تقریباً همیشه آنلاین بودند، اما همین اختلافهای کوچک میتواند برای کسبوکارهایی که به جریانهای کاری مبتنی بر هوش مصنوعی وابستهاند مهم باشد.

رضایت کاربران داستان دیگری را نشان داد. دیپسیک و چتجیپیتی هر دو بالاترین امتیاز رضایت مشتری را با 4.7 از 5 دریافت کردند. پرپلکسیتی اِیآی با 4.6 در تعقیب قرار داشت. متا ایآی در پایین با 3.4 قرار گرفت، در حالی که چند مدل دیگر حول و حوش 4.4 متمرکز بودند.

برای ثبات و کیفیت پاسخها، کیمی ایآی با امتیاز 4.3 از 5 پیشتاز بود. چتجیپیتی، مایکروسافت کاپیلوت و جمینی با امتیاز 4.0 همرتبه بودند. متا ایآی دوباره در انتها با 3.4 قرار گرفت، که نشان میدهد امتیاز ضعیف کلی آن ناشی از یک دسته ضعیف نبوده است.

وقتی همه عوامل ترکیب شدند، پرپلکسیتی اِیآی جایگاه اول را با امتیاز شاخص 85 بهدست آورد. گروک با 79 دوم شد و دیپسیک در پی آن قرار گرفت. چتجیپیتی با امتیاز 50 در رده ششم قرار گرفت، در حالی که جمینی با 41 در رده هشتم بود. متا ایآی در پایین با 37 قرار داشت.

درس بزرگتر این نیست که یک چتبات را بهطور کورکورانه اعتماد کنیم و دیگری را برای همیشه کنار بگذاریم. ابزارهای هوش مصنوعی سریعاً تغییر میکنند. مدلها بهروزرسانی میشوند، محافظها تغییر میکنند و عملکرد میتواند تقریباً یکشبه بهتر شود. با این حال، این نوع رتبهبندی یادآور مفیدی است: مشهورترین چتبات همیشه قابلاعتمادترین نیست، و روانترین پاسخ همیشه پاسخ درست نیست.

برای هر کسی که از هوش مصنوعی در محیط کار استفاده میکند، رویکرد ایمن ساده است. چتباتها را بهعنوان تسریعکننده در نظر بگیرید، نه مراجع نهایی. بگذارید پیشنویس کنند، سازماندهی کنند، خلاصه کنند و ایدهپردازی کنند. اما وقتی پاسخ مربوط به پول، سلامت، قانون، هویت یا تصمیمی با پیامدهای واقعی است، قبل از اقدام حقایق را بررسی کنید.

ارسال نظر